Table des matières

2.4 Traitement récurrent

Par opposition à ce traitement séquentiel, nous considérons une hypothèse alternative qui serait celle

- d'un branchement "non centralisé".

Cela revient à regarder des mécanismes de traitement dans lesquels l'appariement :

- n'est pas réalisé au niveau des neurones,

- mais au niveau d'une population de neurones.

Pour qu'une décision soit réalisée par une population,

- il faut que les neurones échangent de l'information pour aboutir à un "consensus".

- Dans le langage des systèmes dynamiques, on parle de mécanisme de relaxation (voir plus bas).

L'idée est donc que le cerveau, en présence d'un signal, construit sa réponse via une relaxation vers le circuit ayant la meilleure "correspondance" avec ce signal.

Le choix du mécanisme de relaxation, par opposition au produit scalaire,

- ne correspond pas uniquement à un niveau de description plus "fin".

- Il correspond en effet

- à une architecture neuronale différente,

- dite architecture récurrente.

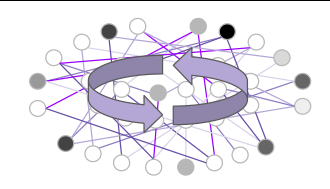

Un réseau de neurones est dit récurrent :

Un réseau de neurones est dit récurrent :

- lorsque le graphe qui le décrit contient des cycles.

- Cela signifie concrètement que le signal produit par les neurones peut circuler à l'infini, "en boucle", à l'intérieur du réseau.

- On parle d'activité interne ou encore activité "endogène".

2.4.1 Systèmes dynamiques

La théorie des systèmes dynamiques repose sur :

- un espace d'état $\mathcal{X}$,

- une trame temporelle $\mathcal{T}$

- et un flot $\phi$ qui est une application de $\mathcal{X} \times \mathcal{T}$ dans $\mathcal{X}$

- définissant pour tout couple $(\boldsymbol{x},t)$

- l'évolution d'état comme~:

\begin{align}\label{eq:SD} \dot{\boldsymbol{x}} = \phi(\boldsymbol{x},t) \end{align}

La trajectoire du système sur la plage temporelle $[t_0,t_f]$ est alors définie par l'intégration sur le flot de la condition initiale $\boldsymbol{x}_0$.

- Dans le cas d'un système dit "autonome", on a $$\phi(\boldsymbol{x},t) = \phi(\boldsymbol{x})$$

- et la trajectoire du système

$$\{\boldsymbol{x}(t)\}_{t \in [t_0,t_f], \boldsymbol{x}(t_0)= \boldsymbol{x}_0}$$

- est entièrement définie par les conditions initiales.

- Dans le cas d'un système dit "ouvert" (non-autonome),

- la dépendance temporelle est souvent modélisée sous la forme d'un signal externe $\boldsymbol{I}(t)$, soit

$$\phi(\boldsymbol{x},t) = \phi(\boldsymbol{x},\boldsymbol{I}(t))$$

- Ce signal peut être:

- une donnée d'entrée dans le cas de modèles de traitement des données

- un bruit externe dans le cas de modèles stochastiques

2.4.2 Attracteurs

Dans le cas des systèmes autonomes dissipatifs, on appelle attracteur une région de l'espace d'état qui tend à attirer les trajectoires du système pour les temps longs.

- Un attracteur est formellement défini comme une région de l'espace d'états invariante par le flot, c'est à dire un ensemble de points $\mathcal{A} \subset \mathcal{X}$ tel que si $\boldsymbol{x}(t) \in \mathcal{A}$, alors $\boldsymbol{x}(t+\tau) \in \mathcal{A}$, avec $\tau > 0$.

- Un attracteur est dit stable s'il existe un voisinage de $\mathcal{A}$ tel que tout point de ce voisinage converge vers l'attracteur pour les temps longs.

- La trajectoire qui va de la condition initiale vers l'attracteur s'appelle la dynamique de relaxation.

- L'ensemble des conditions initiales convergeant vers un attracteur donné s'appelle le bassin d'attraction.

2.4.3 Mécanisme d'appariement dans les systèmes dynamiques

Dans le cas des systèmes non-autonomes, la réponse du réseau correspond à un compromis :

- entre les contraintes internes, exprimées par le graphe,

- et les contraintes externes, exprimées par le signal.

- la convergence vers un attracteur lorsque le signal extérieur est stationnaire,

- ou encore lorsque les changements du signal extérieur sont suffisamment "lents" pour laisser la dynamique converger vers une région de faible volume.

La généralisation des opérateurs d'appariement au cas des dynamiques de relaxation signifie essentiellement~:

- que la dynamique de relaxation doit permettre de séparer l'espace des signaux en régions distinctes.

- Les attracteurs atteints pour certaines classes de signaux doivent être qualitativement différents de ceux obtenus pour d'autres classes de signaux.

- qu'il existe des mécanismes de plasticité permettant

- de faire "bouger les frontières" entre les différentes régions,

- voire d'en créer de nouvelles et d'en faire disparaître.

Séparation des signaux

La transformation des données d'entrée sous la forme d'un (ou plusieurs) vecteur(s) caractéristique(s) correspond à une simplification de ces données.

- Dans le cas des réseaux de neurones à couches, cette simplification correspond à une dimension de la couche de sortie plus faible que celle de la couche d'entrée.

- Dans le cas des réseaux récurrents, cette simplification se traduit

- par une réduction du nombre de degrés de liberté sur lesquels évolue la dynamique des neurones.

- L'activité du réseau accepte alors une description sur un espace de plus petite dimension.